| 功能 | 说明 |

|---|---|

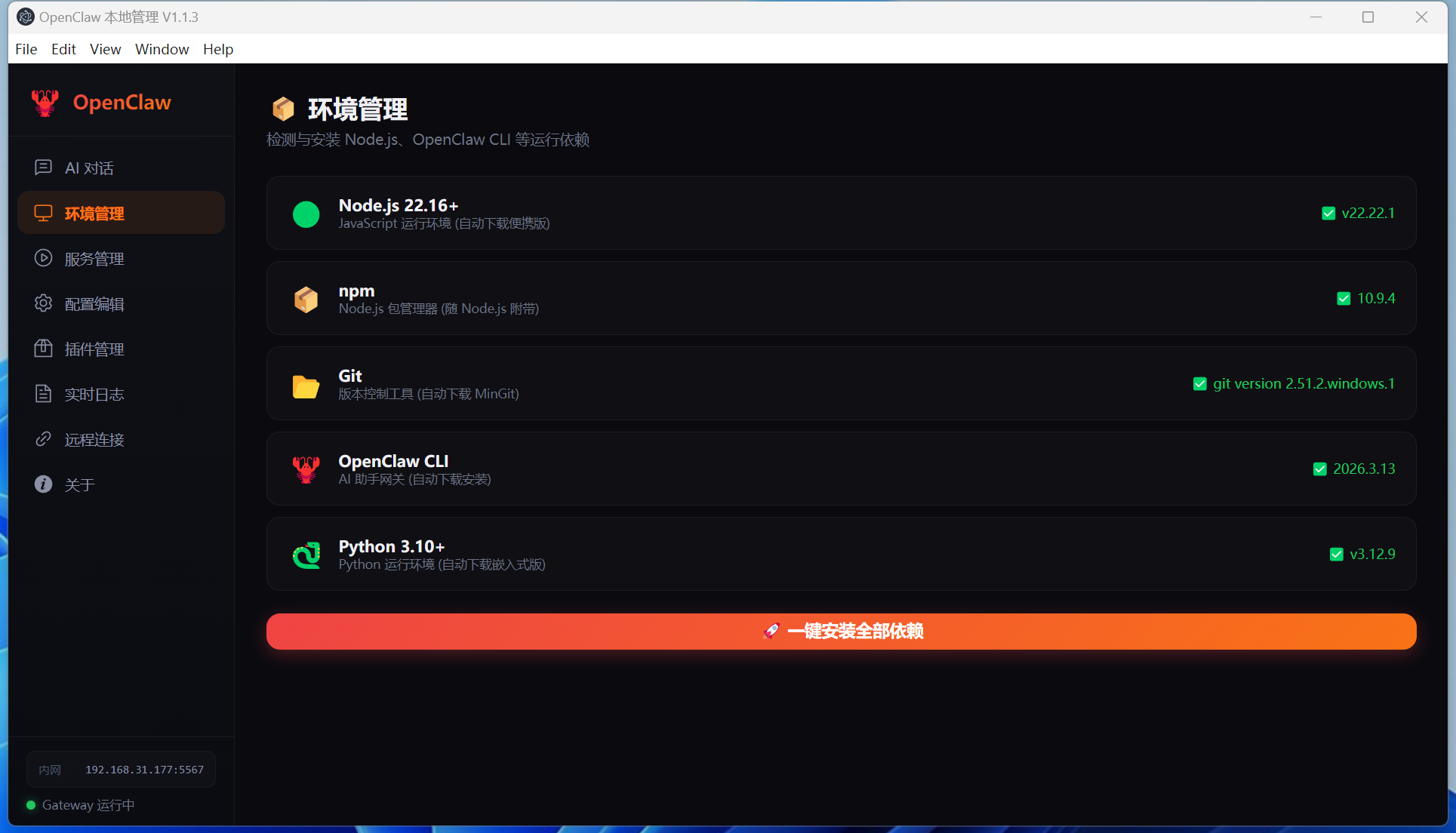

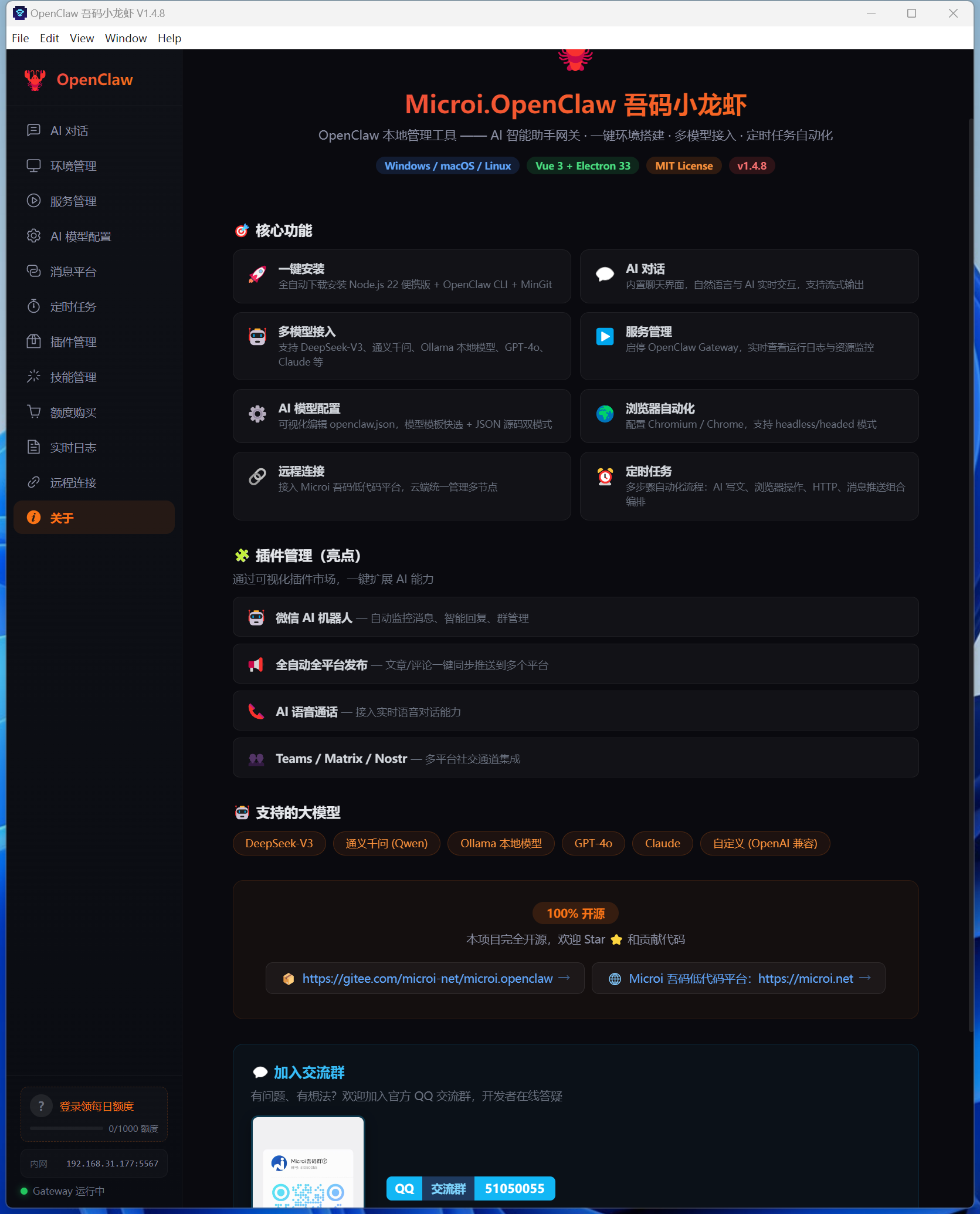

| 🚀 一键部署 | 全自动下载安装 Node.js 22 便携版 + OpenClaw CLI + MinGit,全程国内加速镜像,3 分钟完成全套部署 |

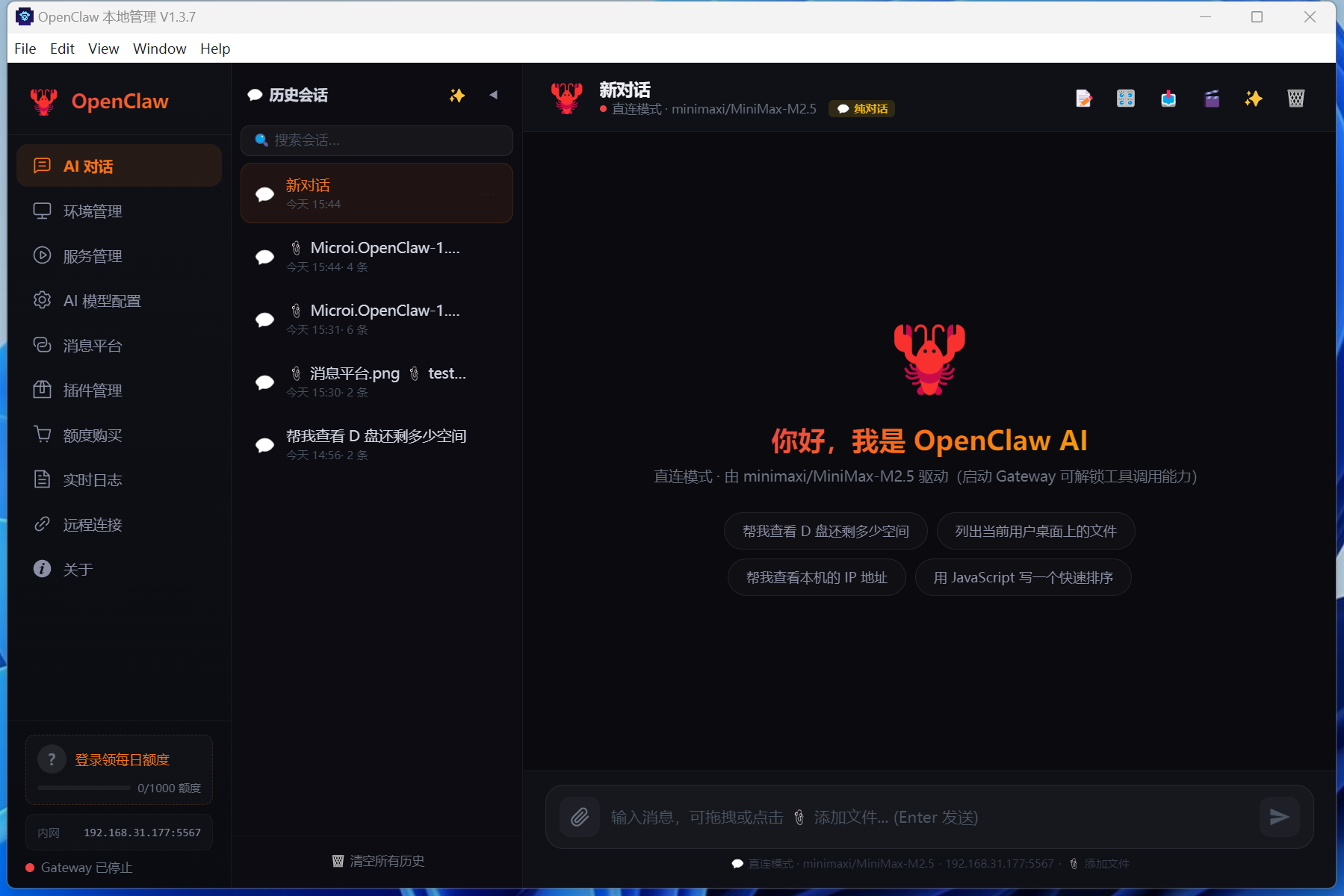

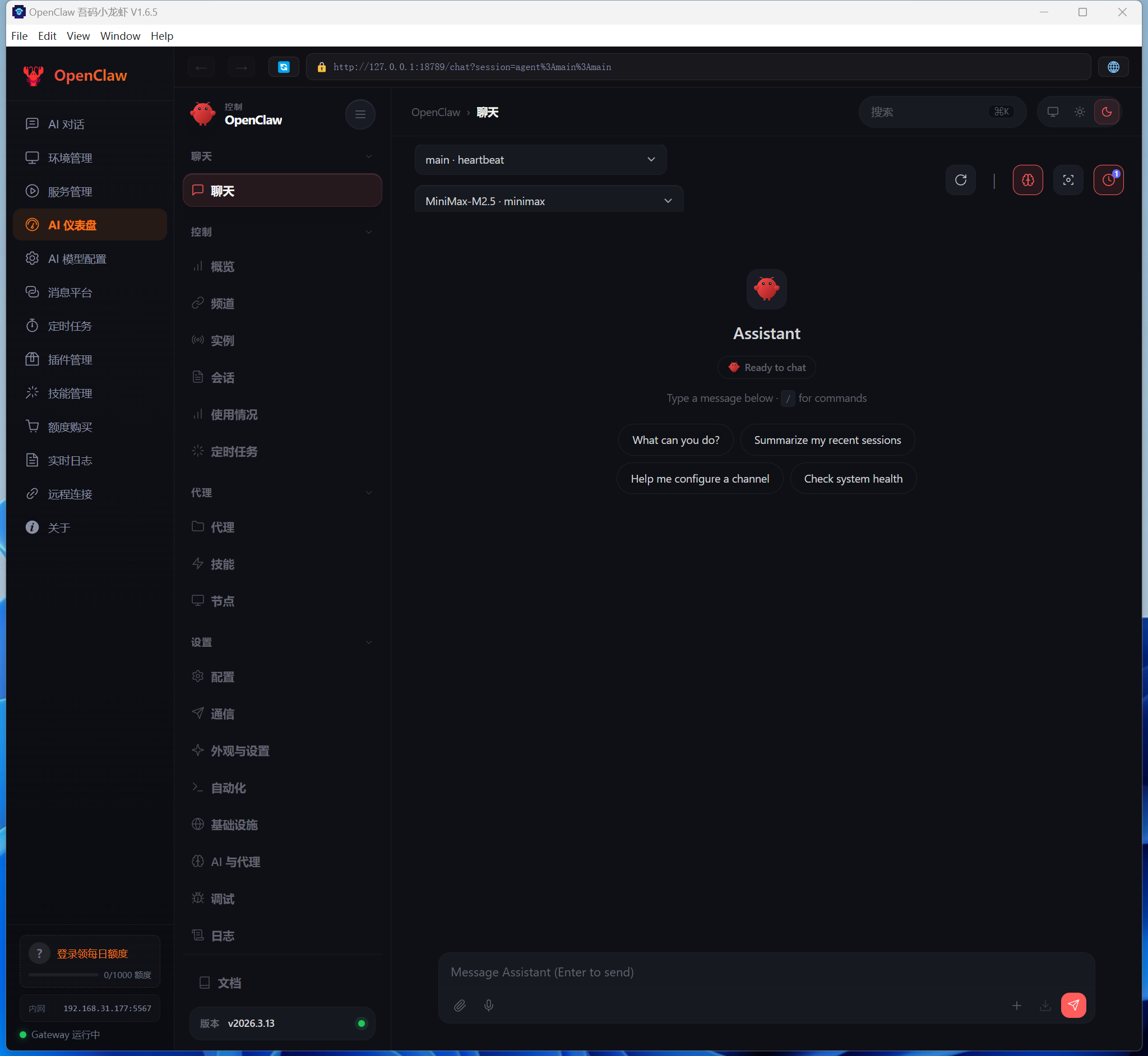

| 💬 AI 对话 | 内置高颜值聊天界面,支持流式输出(SSE),对话数据完全本地存储 |

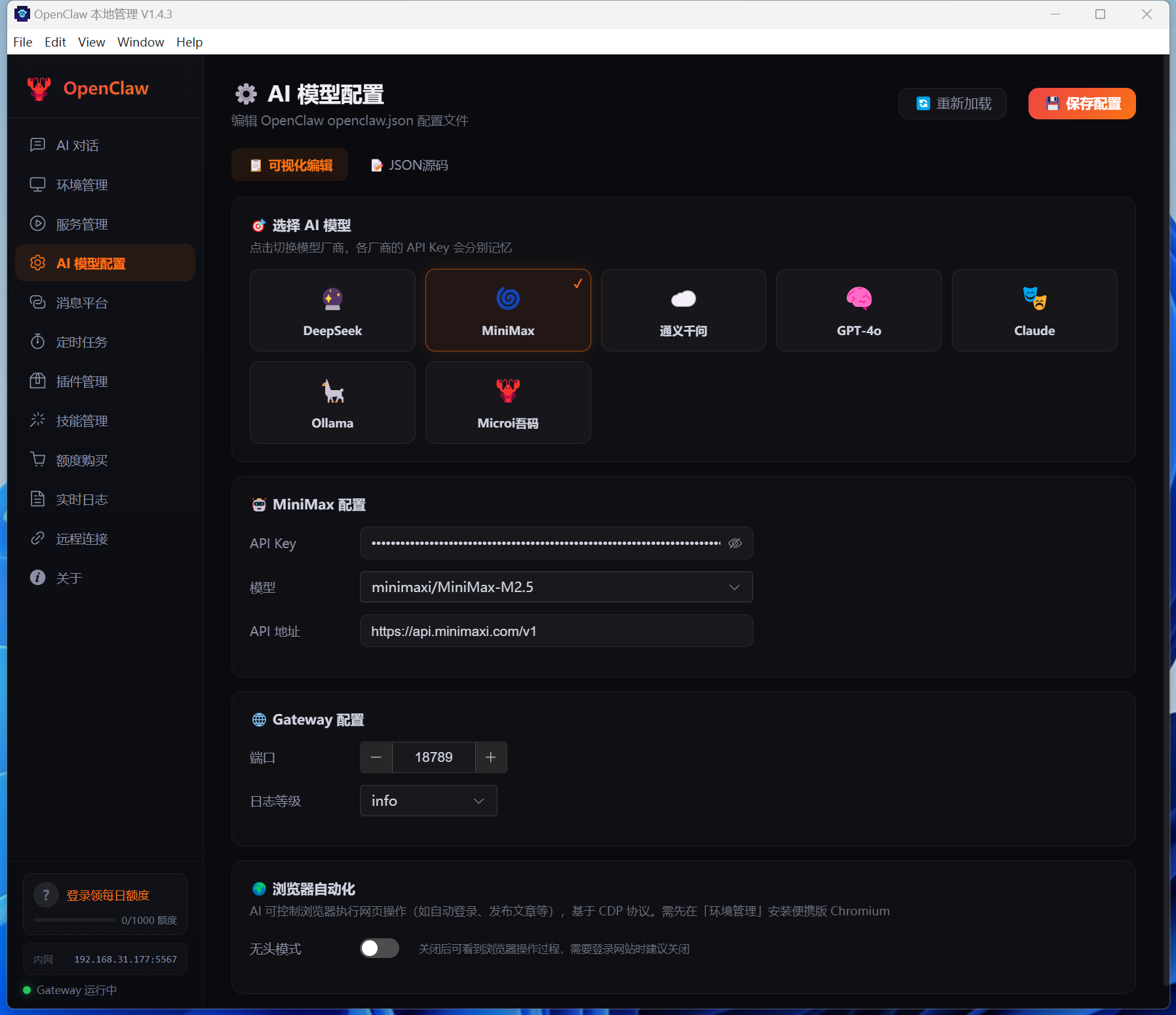

| 🤖 多模型接入 | 内置 DeepSeek-V3、通义千问、MiniMax、Ollama 本地模型、GPT-4o、Claude 等一键模板,填入 API Key 即用;也支持手动填写 Base URL + Key 接入任意 OpenAI 兼容推理服务 |

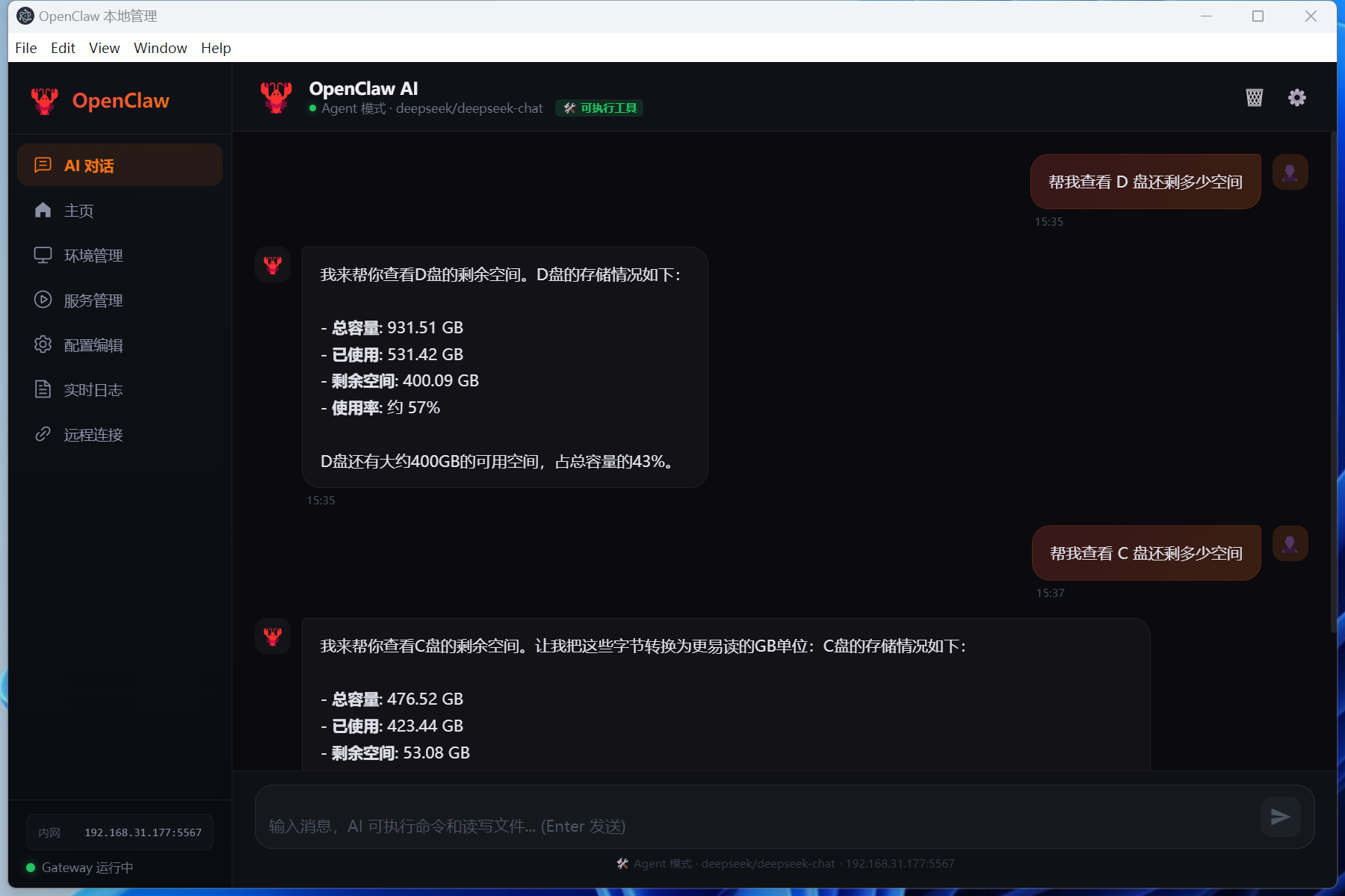

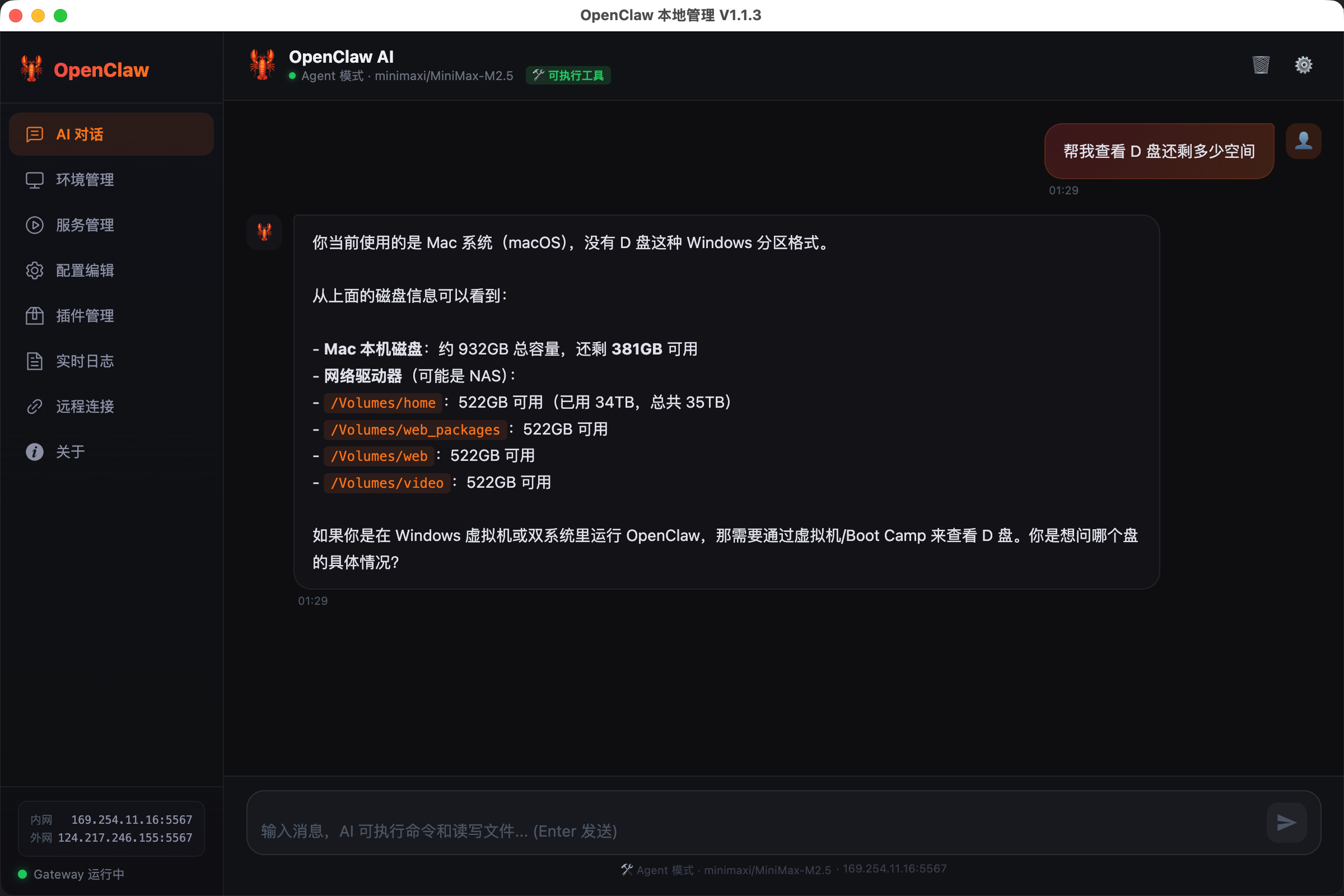

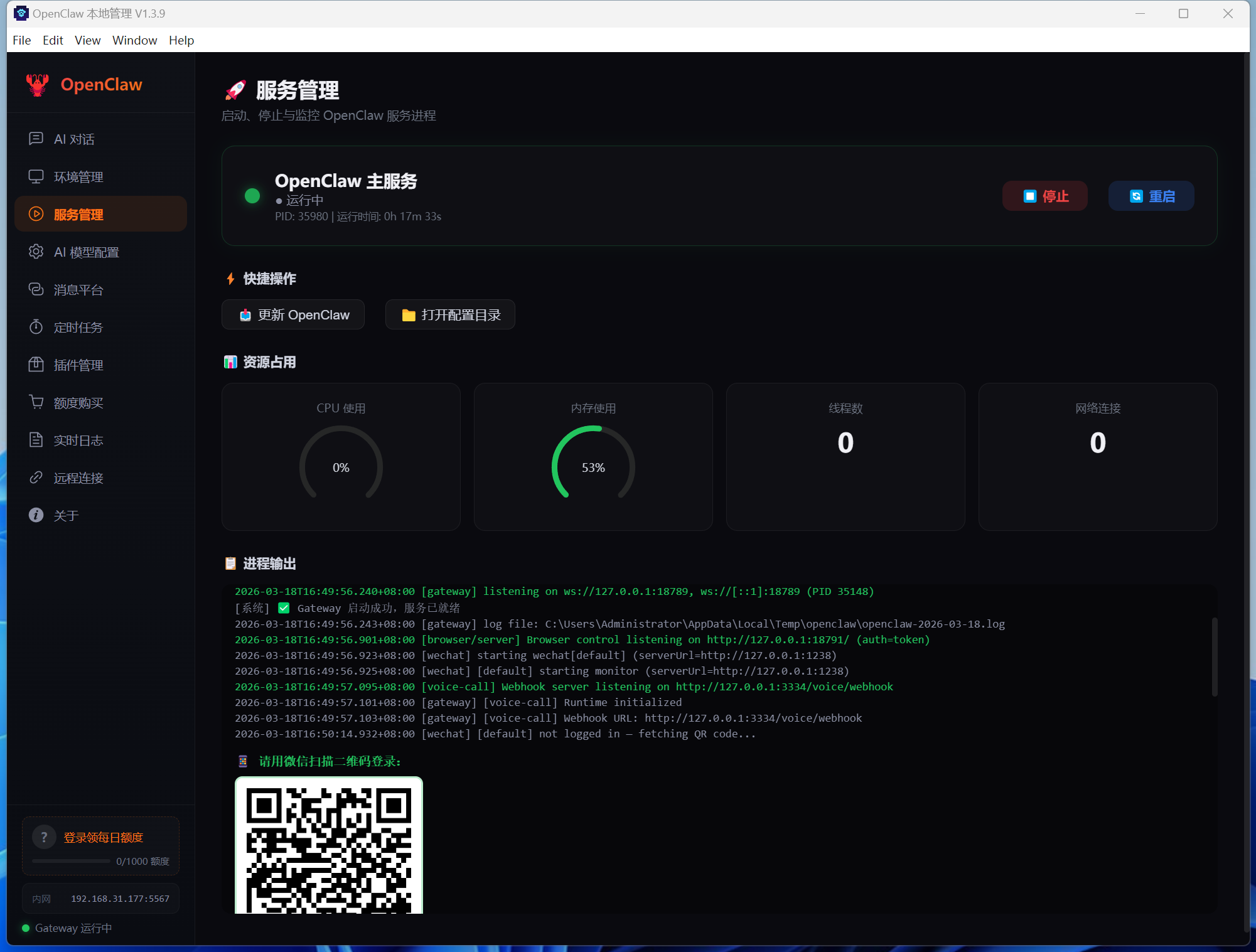

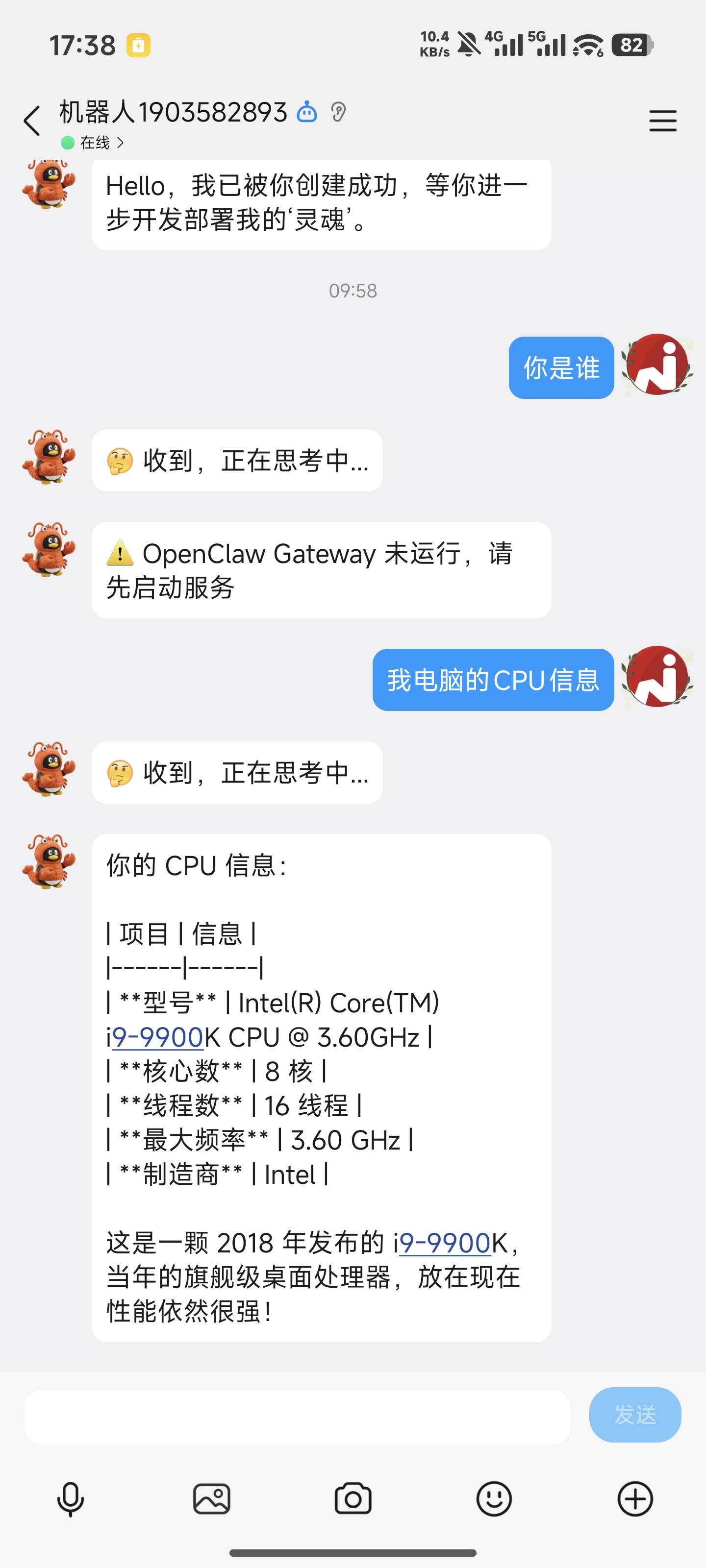

| ▶️ 服务管理 | 可视化启停 OpenClaw 网关,实时日志 · 就绪检测 · CPU/内存/网络全维度监控 |

| ⚙️ AI 模型配置 | 表单模式 + JSON 源码双模式 + 模型模板快选,改完即生效 |

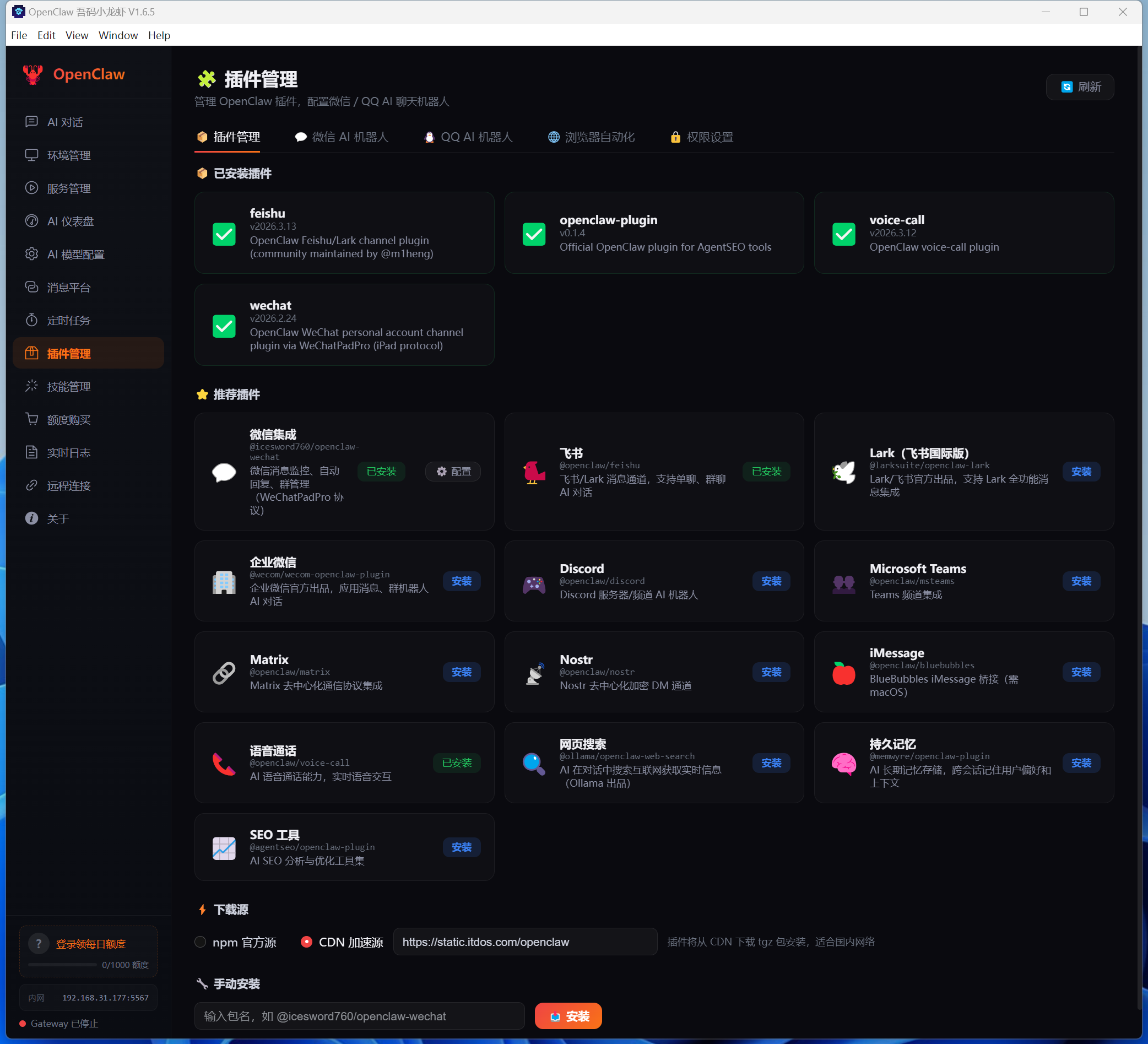

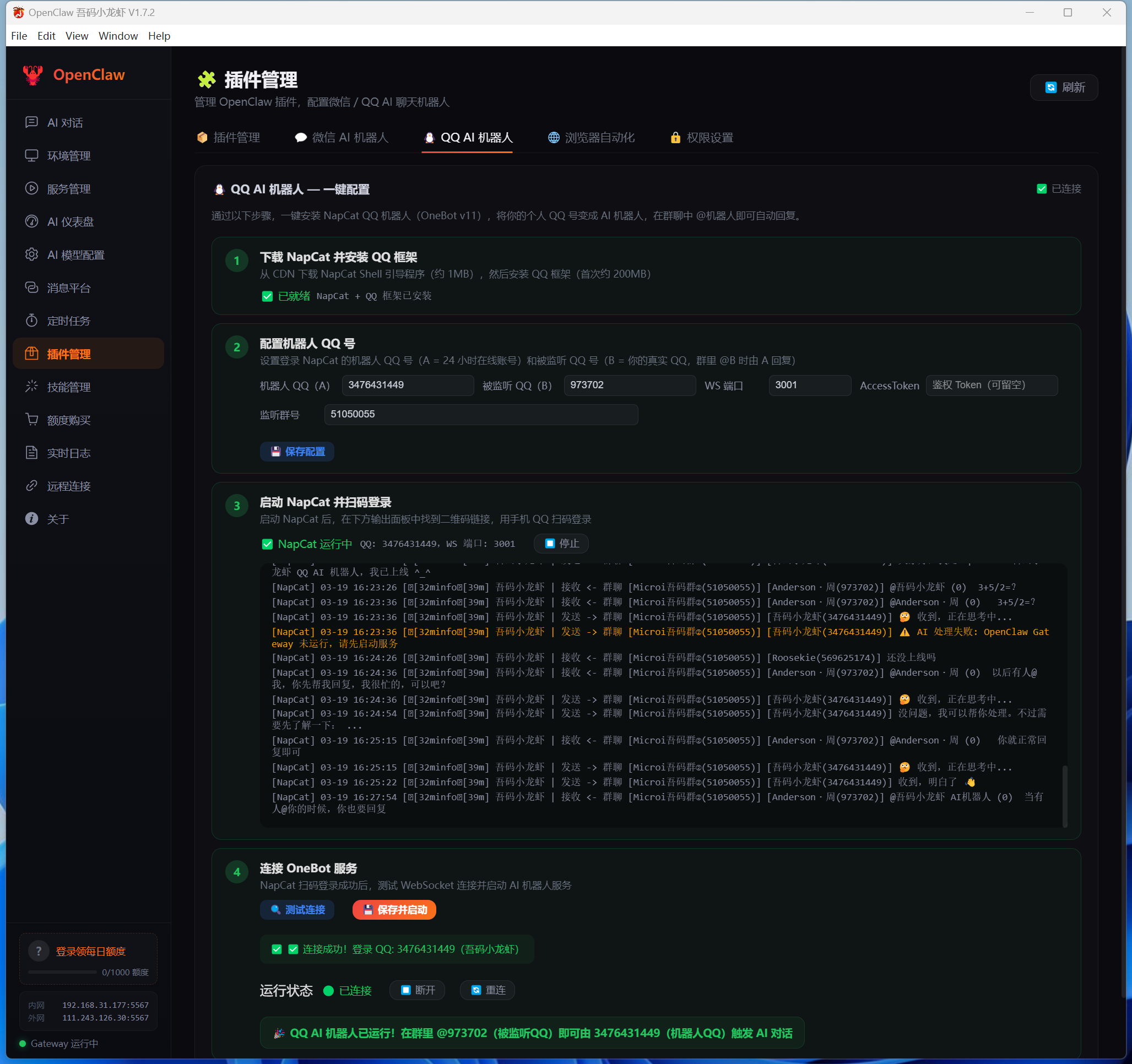

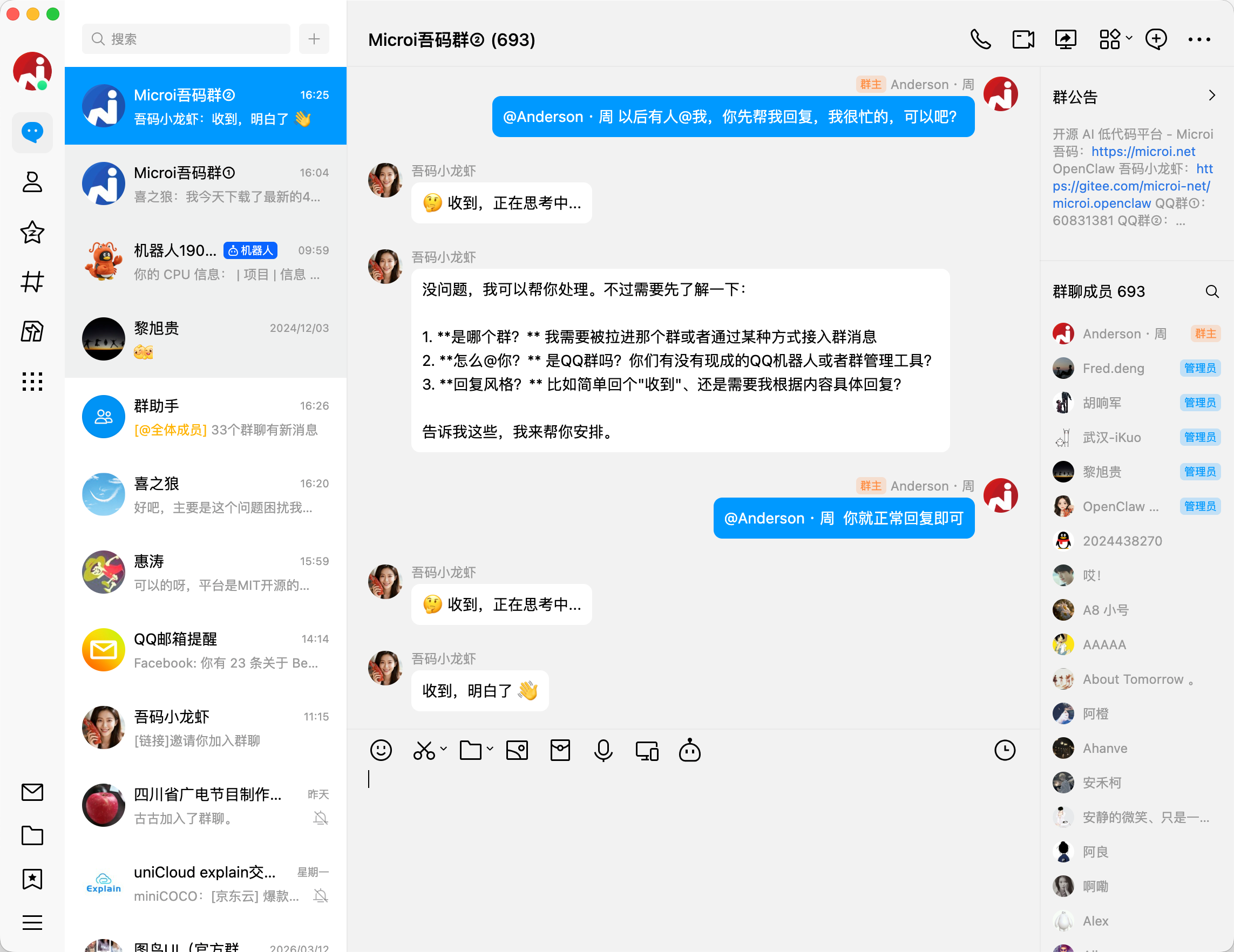

| 🧩 插件管理 | 可视化插件市场,一键安装微信机器人、语音通话、Teams、Matrix 等插件,支持 npm + CDN 双源 |

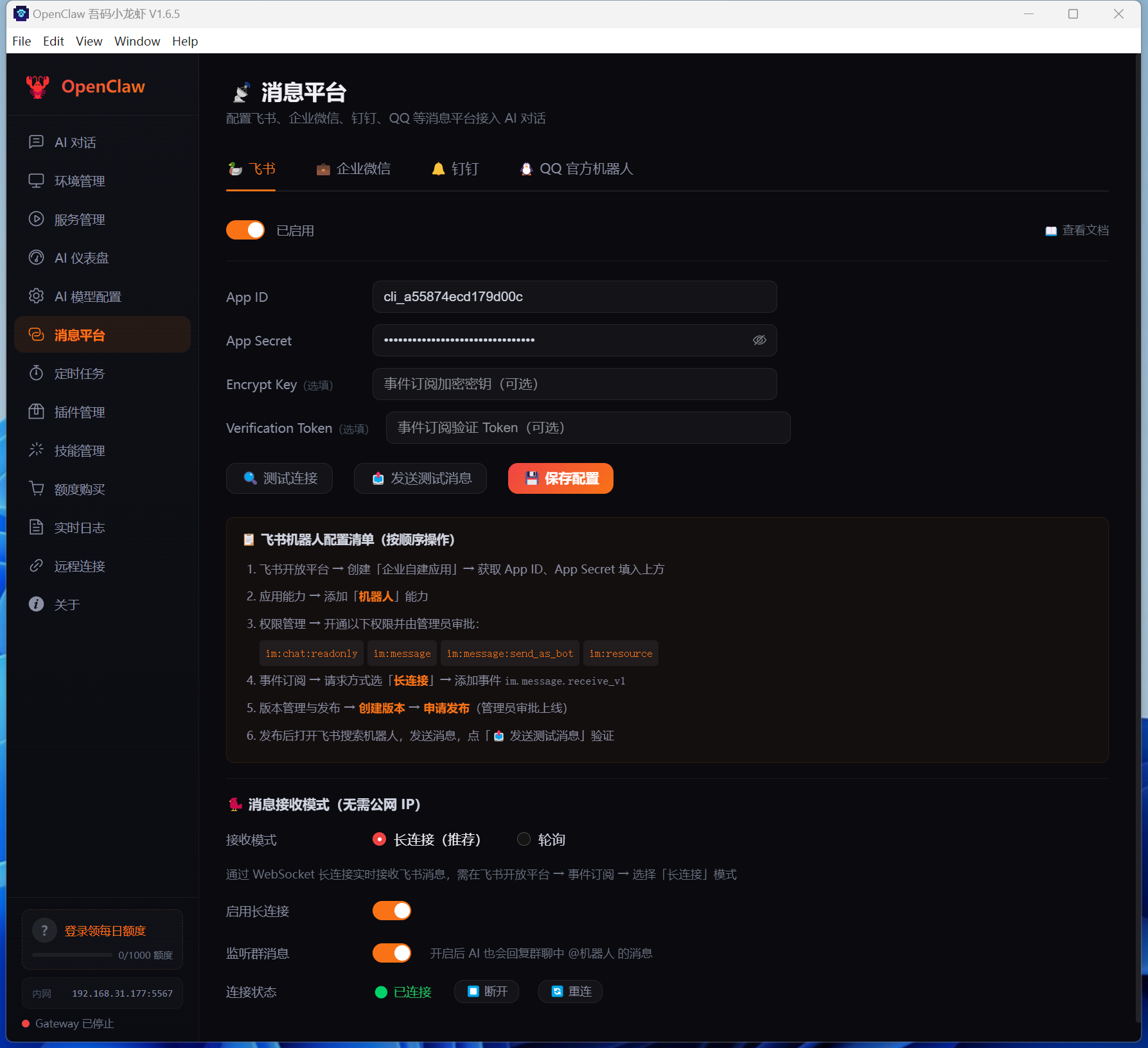

| 📢 消息平台 | 飞书机器人集成,支持 WebSocket 长连接 / 轮询两种模式,自动接收消息并交由 AI 回复 |

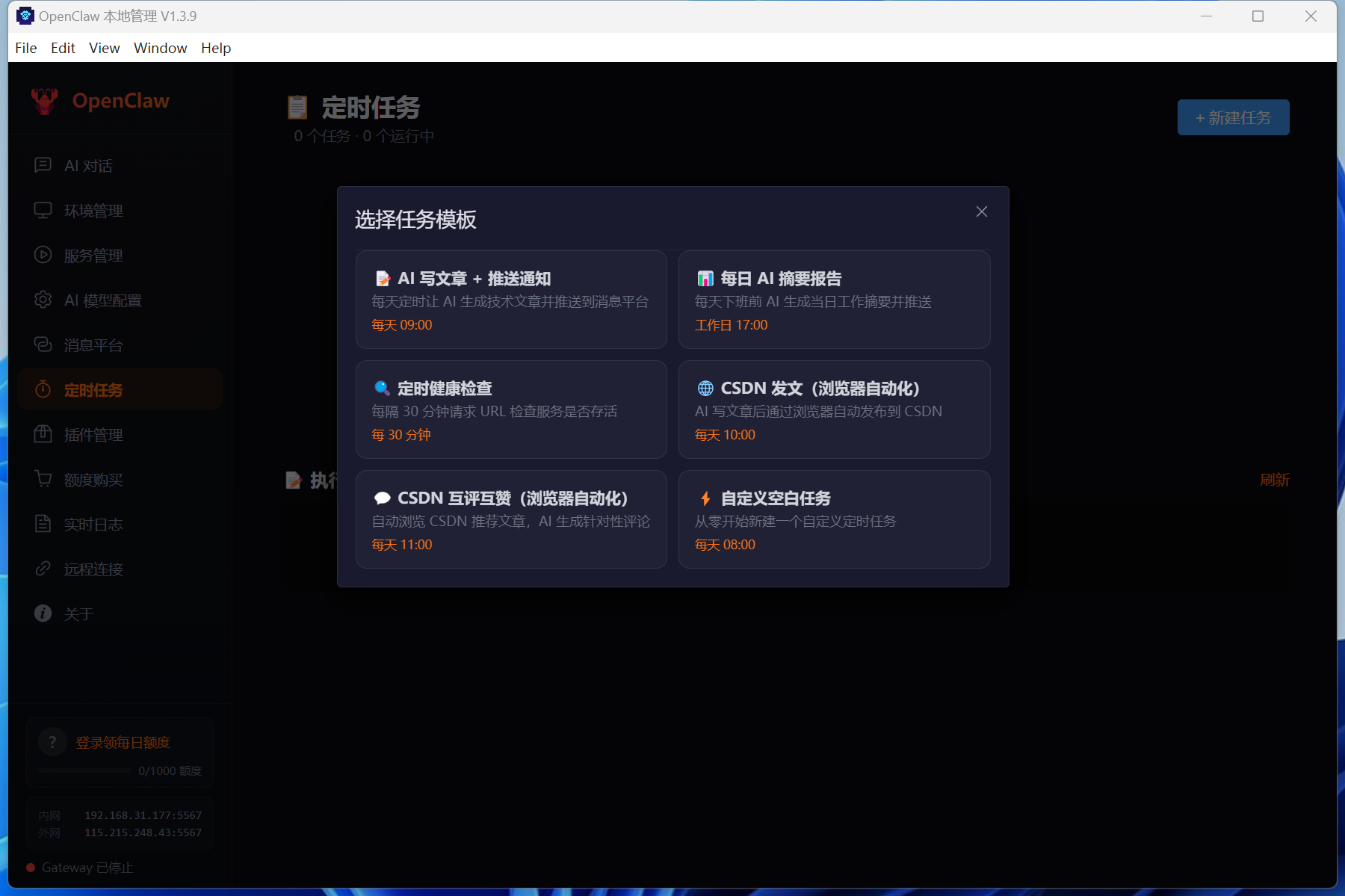

| ⏰ 定时任务 | 多步骤自动化:AI 写文 → 浏览器发文 → 消息推送,像搭积木一样组合(AI 内容生成、浏览器自动化、HTTP 请求、消息推送、延时等待),内置 6 套模板 |

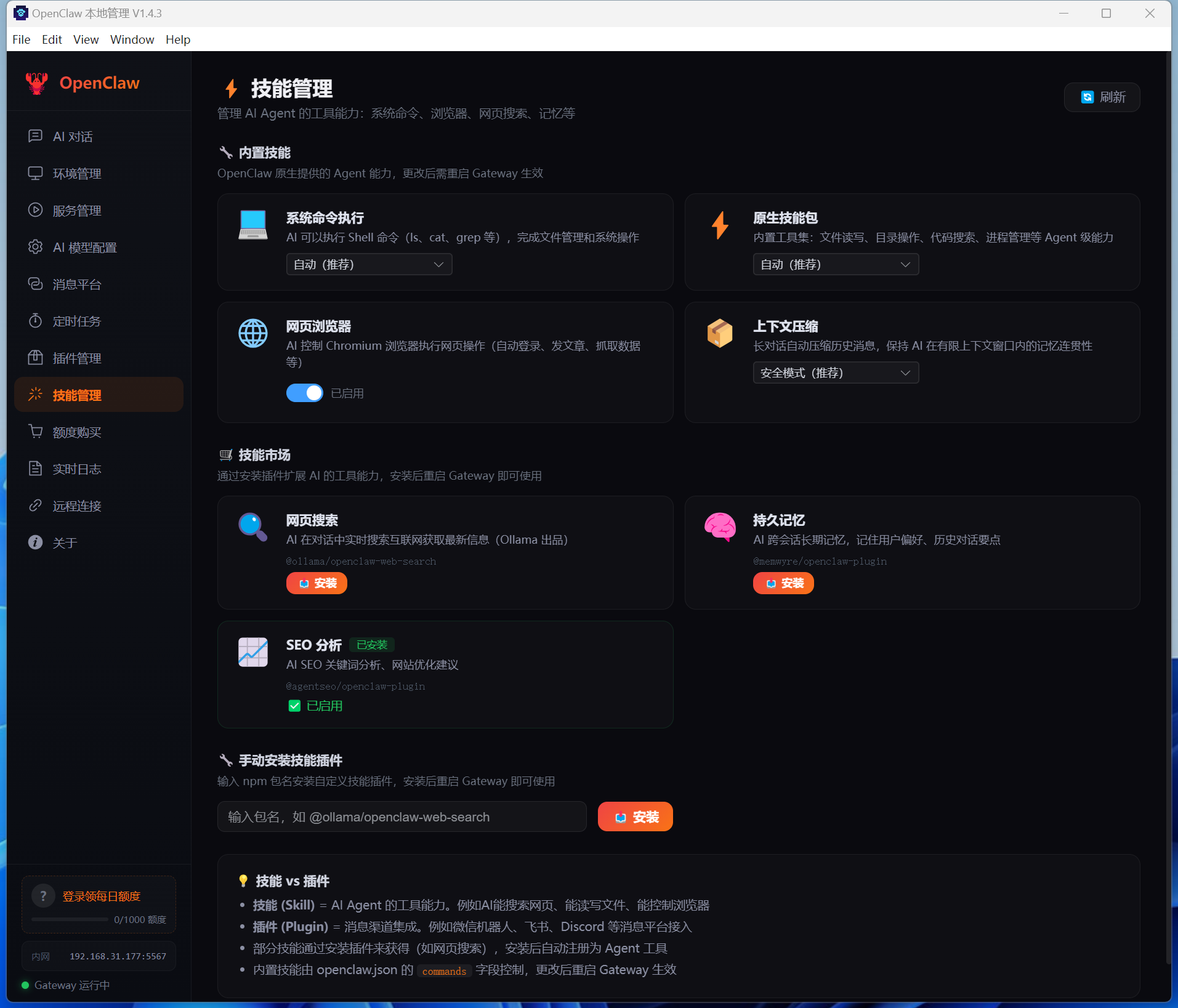

| 🧠 技能管理 | 管理 AI 内置技能(命令执行、浏览器、上下文压缩)及可安装技能(联网搜索、记忆、SEO),支持手动安装自定义技能包 |

| 🌍 浏览器自动化 | 为 AI 赋予「眼睛和手」,headless/headed 模式,CSDN 发文、签到等任务 |

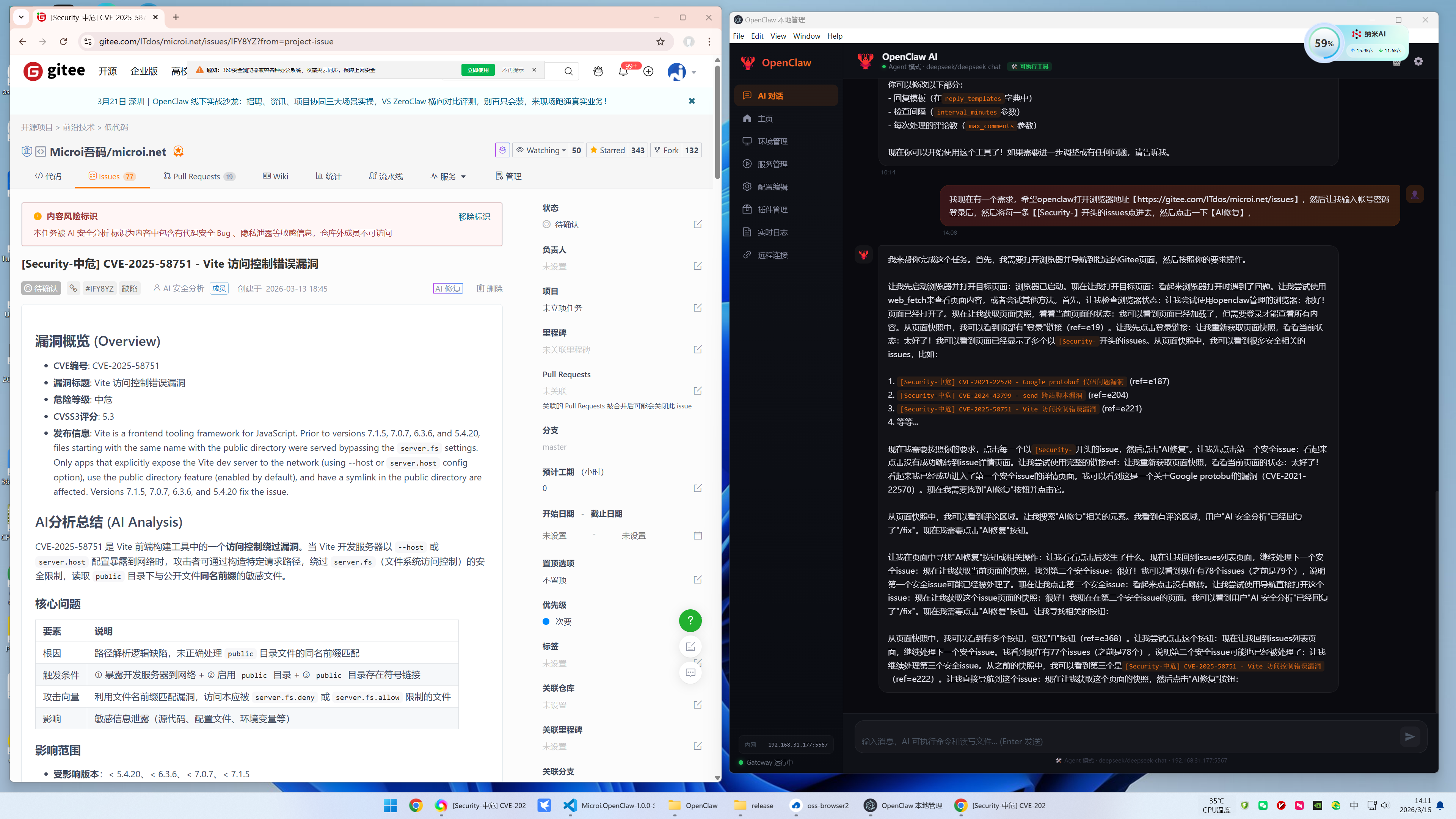

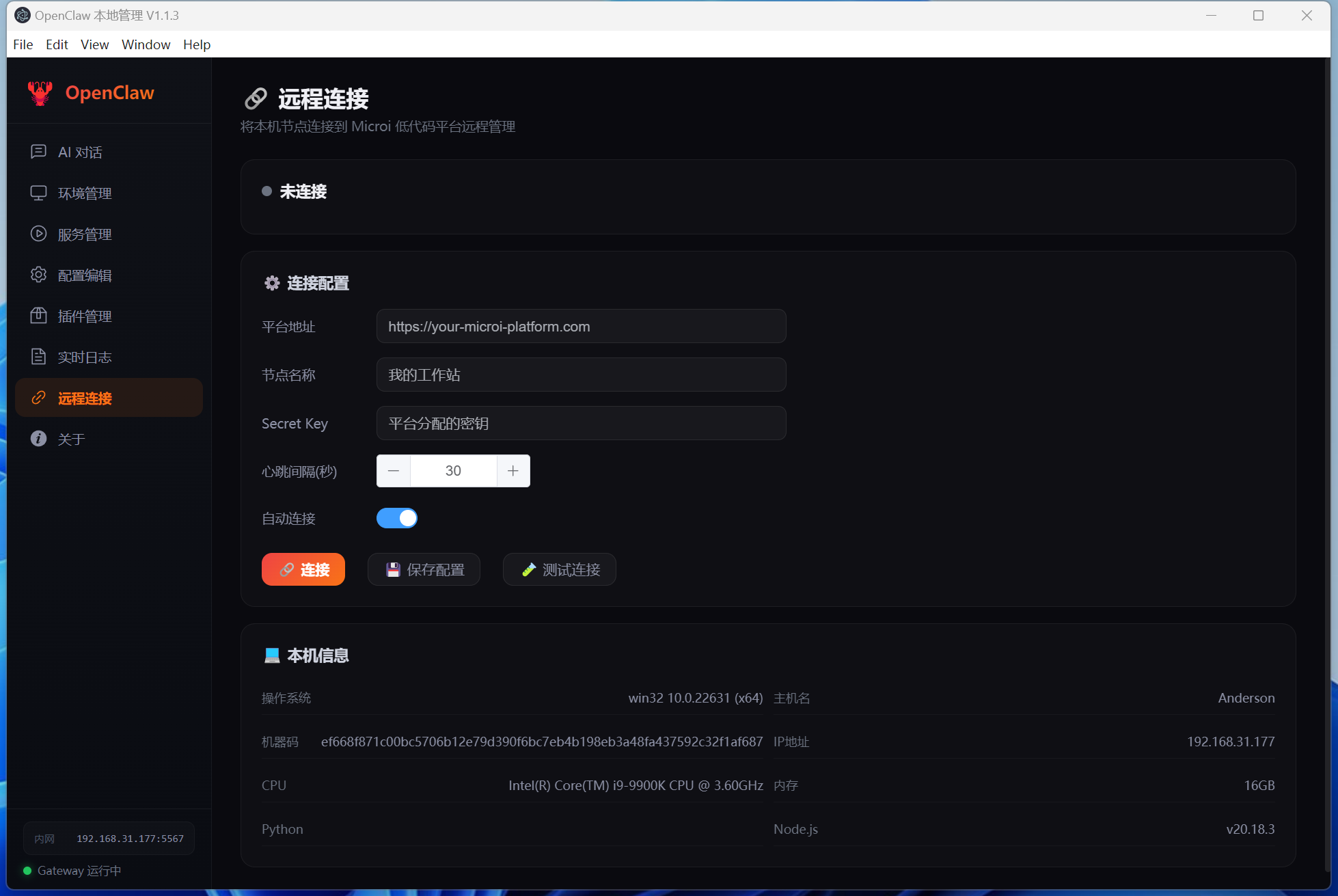

| 🔗 远程连接 | 接入 Microi 吾码低代码平台,实现云端统一管理多节点 |

---

## 🏗️ 架构

```

microi.openclaw/

├── electron/ # Electron 主进程

│ └── main.js # 桌面应用入口

├── src/ # 前端 (Vue 3 + Element Plus)

│ ├── main.js

│ ├── App.vue # 根组件 (暗色主题)

│ ├── router/index.js

│ └── views/

│ ├── Layout.vue # 侧边栏布局

│ ├── Chat.vue # 💬 AI 对话

│ ├── Home.vue # 主页

│ ├── Environment.vue # 环境管理

│ ├── Service.vue # 服务管理 (资源监控)

│ ├── Config.vue # AI 模型配置

│ ├── Plugins.vue # 🧩 插件管理

│ ├── Tasks.vue # ⏰ 定时任务

│ ├── Skills.vue # 🧠 技能管理

│ ├── Channels.vue # 📢 消息平台

│ ├── Logs.vue # 实时日志

│ └── Remote.vue # 远程连接

│

├── server/ # 后端 (Express + WebSocket)

│ ├── index.js # 服务入口

│ ├── utils.js # 工具函数

│ ├── app-config.js # 应用持久化配置

│ ├── scheduler/ # ⏰ 定时任务引擎

│ │ ├── engine.js # Cron 调度 + 变量传递

│ │ └── executors.js # 步骤执行器

│ ├── services/ # 📢 外部服务集成

│ │ ├── feishu-poll.js # 飞书轮询服务

│ │ └── feishu-ws.js # 飞书 WebSocket 长连接

│ └── routes/

│ ├── chat.js # AI 对话代理

│ ├── env.js # 环境检测与安装

│ ├── service.js # Gateway 启停

│ ├── config.js # 配置读写

│ ├── plugins.js # 插件管理

│ ├── tasks.js # 定时任务 CRUD

│ ├── skills.js # 技能管理

│ ├── channels.js # 消息平台 (飞书)

│ ├── logs.js # 日志读取

│ ├── status.js # 系统状态

│ └── remote.js # 远程连接

│

├── dist/ # 前端构建产物

└── release/ # 安装包输出目录

└── Microi.OpenClaw Setup 1.0.0.exe

```

---

## 🚀 快速开始

### 普通用户(推荐,3 分钟上手)

无需任何编程知识,下载安装包双击安装即可 —— **全程国内加速下载,无需额外网络工具**:

| 平台 | 下载 |

|---|---|

| Windows | [Microi.OpenClaw Setup.exe](https://gitee.com/microi-net/microi.openclaw/releases) |

| macOS (Intel) | [Microi.OpenClaw.dmg (x64)](https://gitee.com/microi-net/microi.openclaw/releases) |

| macOS (Apple Silicon) | [Microi.OpenClaw-arm64.dmg](https://gitee.com/microi-net/microi.openclaw/releases) |

| Linux (AppImage) | [Microi.OpenClaw.AppImage](https://gitee.com/microi-net/microi.openclaw/releases) |

| Linux (deb) | [microi-openclaw.deb](https://gitee.com/microi-net/microi.openclaw/releases) |

### 开发者

```bash

git clone https://gitee.com/microi-net/microi.openclaw.git

cd microi.openclaw

npm install

npm run dev

```

## 🔧 开发命令

```bash

# 同时启动前端 + 后端(Web 开发模式)

npm run dev

# Electron 开发模式(桌面窗口)

npm run dev:electron

# 仅启动后端

npm run dev:server

# 仅启动前端

npm run dev:client

# 构建前端

npm run build:web

# 构建 Windows 安装包

npm run build:win

# 构建 macOS 安装包(Intel + Apple Silicon)

npm run build:mac

# 构建 Linux 安装包

npm run build:linux

```

---

### 首次使用(5 步完成部署)

1. 打开 **吾码小龙虾**,进入 **环境管理** 页面

2. 点击 **🚀 一键安装全部依赖**(程序自动通过国内镜像下载 Node.js 22 便携版 + OpenClaw 小龙虾 CLI + MinGit,无需手动操作)

3. 全部显示 ✅ 后,进入 **AI 模型配置** 页面

4. 选择模型模板(如 **DeepSeek V3**),填入 API Key,点击保存

5. 进入 **服务管理** 点击启动,等待服务就绪提示后即可在 **AI 对话** 中与 AI 畅聊

---

## ⚙️ 独立运行 vs 接入 Microi 平台

本工具**开箱即用**,完全独立运行,不依赖任何云端服务。

也可作为 [Microi 吾码低代码平台](https://microi.net) 的**本地节点**,实现多节点集中管控:

```

┌─────────────────────────┐

│ Microi 吾码低代码平台 │

│ (云端 / 内网服务器) │

│ 统一管理多个节点 │

└─────┬───────────┬─────────┘

│ │

心跳上报 │ │ 心跳上报

▼ ▼

┌───────────────┐ ┌───────────────┐

│ 节点A (Win) │ │ 节点B (Mac) │

│ microi.openclaw│ │ microi.openclaw│

│ ↓ 管理 ↓ │ │ ↓ 管理 ↓ │

│ OpenClaw GW │ │ OpenClaw GW │

└───────────────┘ └───────────────┘

```

---

## 🛠️ 技术栈

| 层级 | 技术 | 说明 |

|---|---|---|

| 桌面框架 | Electron 33 | 跨平台桌面应用 |

| 前端框架 | Vue 3 + Vite | 现代化前端工具链 |

| UI 组件 | Element Plus | 企业级组件库 |

| 后端框架 | Express 4 | Node.js Web 框架 |

| AI 运行时 | OpenClaw | Node.js/TypeScript AI 助手网关 |

| 定时调度 | node-cron | 轻量级 Cron 定时任务引擎 |

| 实时通信 | ws (WebSocket) | 日志推送 & 进程输出 & 任务状态 |

| 进程管理 | tree-kill | 跨平台进程树终止 |

| 机器标识 | node-machine-id | 生成机器唯一码 |

---

## 📝 配置说明

### 配置文件

OpenClaw 使用 `~/.openclaw/openclaw.json` 作为全局配置文件,可通过管理界面的 **AI 模型配置** 页面修改。

### 配置持久化

应用配置(API Key、模型、Provider 等)会自动保存到独立的持久化目录,**重装 exe 不会丢失**:

| 平台 | 持久化路径 |

|---|---|

| Windows | `%APPDATA%\microi-openclaw\config.json` |

| macOS | `~/Library/Application Support/microi-openclaw/config.json` |

| Linux | `~/.config/microi-openclaw/config.json` |

重装后首次启动时,程序会自动从持久化配置恢复 OpenClaw 配置文件,无需重新手动配置。

### 端口

| 服务 | 端口 | 说明 |

|---|---|---|

| 前端开发 | 5566 | Vite 开发服务器 |

| 管理后端 | 5567+ | Express + WebSocket(占用时自动 +1,最多尝试 10 次) |

| OpenClaw Gateway | 18789 | OpenClaw AI 网关(可在配置中修改) |

---

#### Linux 安装部署

**方式一:AppImage(推荐,免安装)**

```bash

# 下载后赋予执行权限

chmod +x Microi.OpenClaw-*.AppImage

# 直接运行(带图形界面的桌面环境)

./Microi.OpenClaw-*.AppImage

# 如果运行报错 FUSE,使用 --no-sandbox 参数

./Microi.OpenClaw-*.AppImage --no-sandbox

```

**方式二:deb 包安装(Ubuntu / Debian)**

```bash

sudo dpkg -i microi-openclaw_*.deb

# 如有依赖缺失,执行:

sudo apt-get install -f

```

**方式三:无图形界面的服务器(纯命令行部署)**

如果你的 Linux 服务器没有桌面环境,可以直接运行后端服务:

```bash

# 1. 安装 Node.js 22(推荐使用 nvm)

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.3/install.sh | bash

source ~/.bashrc

nvm install 22

# 2. 安装 OpenClaw CLI

npm install -g openclaw@latest --registry https://registry.npmmirror.com

# 3. 克隆项目并安装依赖

git clone https://gitee.com/microi-net/microi.openclaw.git

cd microi.openclaw

npm install --registry https://registry.npmmirror.com

# 4. 构建前端

npm run build:web

# 5. 启动服务(前端 + 后端管理面板)

npm run start

# 服务默认监听 5567 端口,浏览器访问 http://你的服务器IP:5567 即可打开管理界面

```

> 💡 **后台运行提示**:可使用 `nohup`、`screen`、`tmux` 或 `pm2` 保持服务常驻:

> ```bash

> # 使用 pm2(推荐)

> npm install -g pm2

> pm2 start server/index.js --name openclaw -- --production

> pm2 save && pm2 startup

>

> # 或使用 nohup

> nohup npm run start > openclaw.log 2>&1 &

> ```

## ❓ 常见问题

> **Windows 开发者注意(使用 nvm4w 时)**

>

> 如果你使用 [nvm for Windows](https://github.com/coreybutler/nvm-windows) 管理 Node.js 版本,首次切换版本后 PowerShell 可能报错:

> ```

> 无法加载文件 npm.ps1,因为在此系统上禁止运行脚本

> ```

> 执行以下命令解决(只需一次):

> ```powershell

> Set-ExecutionPolicy -ExecutionPolicy RemoteSigned -Scope CurrentUser

> ```

### Q: 环境安装速度慢或失败?

程序默认走国内加速镜像(Node.js 镜像站 + npmmirror),正常情况下国内网络几十秒即可完成。如多次失败:

- 检查本机网络是否正常

- 在环境管理页面重试单项安装

- 也可手动安装 Node.js 22 并加入 PATH,程序会自动识别

### Q: 安装 OpenClaw CLI 失败?

```bash

# 手动安装(国内加速)

npm install -g openclaw@latest --registry https://registry.npmmirror.com

```

### Q: 端口 5567 被占用?

程序会自动尝试 5567 ~ 5576 共 10 个端口。如果全部被占用,请先释放端口。

### Q: 如何使用 Ollama 本地模型?

1. 安装并启动 [Ollama](https://ollama.com/)

2. 在配置编辑中选择 **Ollama** 模板

3. 确认 Base URL 为 `http://localhost:11434`

4. 填入模型名(如 `llama3.1`)

5. 保存并重启 Gateway

### Q: 如何从外网访问?

侧边栏底部显示当前服务的内网 IP 和端口。在路由器设置端口映射(将外网端口映射到该 IP:端口)即可外网访问。

### Q: Linux 服务器(无桌面)如何部署?

不需要 Electron 桌面环境,直接用 Node.js 运行后端即可。详见上方「**无图形界面的服务器(纯命令行部署)**」章节,通过浏览器访问管理界面。

### Q: Linux 运行 AppImage 报 FUSE 相关错误?

较新版本的 Linux 可能未预装 FUSE:

```bash

# Ubuntu/Debian

sudo apt-get install fuse libfuse2

# CentOS/RHEL

sudo yum install fuse fuse-libs

# 或直接加 --no-sandbox 参数运行

./Microi.OpenClaw-*.AppImage --no-sandbox

```

### Q: 安装插件超时或失败?

1. 切换下载源:在 **插件管理** 页面将下载源切换为 **CDN 加速源**

2. CDN 方式从 `https://static.itdos.com/openclaw` 下载,国内网络更稳定

3. 如果 CDN 也失败,检查网络连接或联系管理员确认 CDN 资源已上传

### Q: 启动 Gateway 报端口 18789 被占用?

程序启动时会**自动尝试终止**占用 18789 端口的旧进程。如果仍然报错:

```bash

# Windows:手动查找并终止占用端口的进程

netstat -ano | findstr :18789

taskkill /F /PID <上面查到的PID>

# macOS / Linux

lsof -i :18789

kill -9

---

## 🏗️ 架构

```

microi.openclaw/

├── electron/ # Electron 主进程

│ └── main.js # 桌面应用入口

├── src/ # 前端 (Vue 3 + Element Plus)

│ ├── main.js

│ ├── App.vue # 根组件 (暗色主题)

│ ├── router/index.js

│ └── views/

│ ├── Layout.vue # 侧边栏布局

│ ├── Chat.vue # 💬 AI 对话

│ ├── Home.vue # 主页

│ ├── Environment.vue # 环境管理

│ ├── Service.vue # 服务管理 (资源监控)

│ ├── Config.vue # AI 模型配置

│ ├── Plugins.vue # 🧩 插件管理

│ ├── Tasks.vue # ⏰ 定时任务

│ ├── Skills.vue # 🧠 技能管理

│ ├── Channels.vue # 📢 消息平台

│ ├── Logs.vue # 实时日志

│ └── Remote.vue # 远程连接

│

├── server/ # 后端 (Express + WebSocket)

│ ├── index.js # 服务入口

│ ├── utils.js # 工具函数

│ ├── app-config.js # 应用持久化配置

│ ├── scheduler/ # ⏰ 定时任务引擎

│ │ ├── engine.js # Cron 调度 + 变量传递

│ │ └── executors.js # 步骤执行器

│ ├── services/ # 📢 外部服务集成

│ │ ├── feishu-poll.js # 飞书轮询服务

│ │ └── feishu-ws.js # 飞书 WebSocket 长连接

│ └── routes/

│ ├── chat.js # AI 对话代理

│ ├── env.js # 环境检测与安装

│ ├── service.js # Gateway 启停

│ ├── config.js # 配置读写

│ ├── plugins.js # 插件管理

│ ├── tasks.js # 定时任务 CRUD

│ ├── skills.js # 技能管理

│ ├── channels.js # 消息平台 (飞书)

│ ├── logs.js # 日志读取

│ ├── status.js # 系统状态

│ └── remote.js # 远程连接

│

├── dist/ # 前端构建产物

└── release/ # 安装包输出目录

└── Microi.OpenClaw Setup 1.0.0.exe

```

---

## 🚀 快速开始

### 普通用户(推荐,3 分钟上手)

无需任何编程知识,下载安装包双击安装即可 —— **全程国内加速下载,无需额外网络工具**:

| 平台 | 下载 |

|---|---|

| Windows | [Microi.OpenClaw Setup.exe](https://gitee.com/microi-net/microi.openclaw/releases) |

| macOS (Intel) | [Microi.OpenClaw.dmg (x64)](https://gitee.com/microi-net/microi.openclaw/releases) |

| macOS (Apple Silicon) | [Microi.OpenClaw-arm64.dmg](https://gitee.com/microi-net/microi.openclaw/releases) |

| Linux (AppImage) | [Microi.OpenClaw.AppImage](https://gitee.com/microi-net/microi.openclaw/releases) |

| Linux (deb) | [microi-openclaw.deb](https://gitee.com/microi-net/microi.openclaw/releases) |

### 开发者

```bash

git clone https://gitee.com/microi-net/microi.openclaw.git

cd microi.openclaw

npm install

npm run dev

```

## 🔧 开发命令

```bash

# 同时启动前端 + 后端(Web 开发模式)

npm run dev

# Electron 开发模式(桌面窗口)

npm run dev:electron

# 仅启动后端

npm run dev:server

# 仅启动前端

npm run dev:client

# 构建前端

npm run build:web

# 构建 Windows 安装包

npm run build:win

# 构建 macOS 安装包(Intel + Apple Silicon)

npm run build:mac

# 构建 Linux 安装包

npm run build:linux

```

---

### 首次使用(5 步完成部署)

1. 打开 **吾码小龙虾**,进入 **环境管理** 页面

2. 点击 **🚀 一键安装全部依赖**(程序自动通过国内镜像下载 Node.js 22 便携版 + OpenClaw 小龙虾 CLI + MinGit,无需手动操作)

3. 全部显示 ✅ 后,进入 **AI 模型配置** 页面

4. 选择模型模板(如 **DeepSeek V3**),填入 API Key,点击保存

5. 进入 **服务管理** 点击启动,等待服务就绪提示后即可在 **AI 对话** 中与 AI 畅聊

---

## ⚙️ 独立运行 vs 接入 Microi 平台

本工具**开箱即用**,完全独立运行,不依赖任何云端服务。

也可作为 [Microi 吾码低代码平台](https://microi.net) 的**本地节点**,实现多节点集中管控:

```

┌─────────────────────────┐

│ Microi 吾码低代码平台 │

│ (云端 / 内网服务器) │

│ 统一管理多个节点 │

└─────┬───────────┬─────────┘

│ │

心跳上报 │ │ 心跳上报

▼ ▼

┌───────────────┐ ┌───────────────┐

│ 节点A (Win) │ │ 节点B (Mac) │

│ microi.openclaw│ │ microi.openclaw│

│ ↓ 管理 ↓ │ │ ↓ 管理 ↓ │

│ OpenClaw GW │ │ OpenClaw GW │

└───────────────┘ └───────────────┘

```

---

## 🛠️ 技术栈

| 层级 | 技术 | 说明 |

|---|---|---|

| 桌面框架 | Electron 33 | 跨平台桌面应用 |

| 前端框架 | Vue 3 + Vite | 现代化前端工具链 |

| UI 组件 | Element Plus | 企业级组件库 |

| 后端框架 | Express 4 | Node.js Web 框架 |

| AI 运行时 | OpenClaw | Node.js/TypeScript AI 助手网关 |

| 定时调度 | node-cron | 轻量级 Cron 定时任务引擎 |

| 实时通信 | ws (WebSocket) | 日志推送 & 进程输出 & 任务状态 |

| 进程管理 | tree-kill | 跨平台进程树终止 |

| 机器标识 | node-machine-id | 生成机器唯一码 |

---

## 📝 配置说明

### 配置文件

OpenClaw 使用 `~/.openclaw/openclaw.json` 作为全局配置文件,可通过管理界面的 **AI 模型配置** 页面修改。

### 配置持久化

应用配置(API Key、模型、Provider 等)会自动保存到独立的持久化目录,**重装 exe 不会丢失**:

| 平台 | 持久化路径 |

|---|---|

| Windows | `%APPDATA%\microi-openclaw\config.json` |

| macOS | `~/Library/Application Support/microi-openclaw/config.json` |

| Linux | `~/.config/microi-openclaw/config.json` |

重装后首次启动时,程序会自动从持久化配置恢复 OpenClaw 配置文件,无需重新手动配置。

### 端口

| 服务 | 端口 | 说明 |

|---|---|---|

| 前端开发 | 5566 | Vite 开发服务器 |

| 管理后端 | 5567+ | Express + WebSocket(占用时自动 +1,最多尝试 10 次) |

| OpenClaw Gateway | 18789 | OpenClaw AI 网关(可在配置中修改) |

---

#### Linux 安装部署

**方式一:AppImage(推荐,免安装)**

```bash

# 下载后赋予执行权限

chmod +x Microi.OpenClaw-*.AppImage

# 直接运行(带图形界面的桌面环境)

./Microi.OpenClaw-*.AppImage

# 如果运行报错 FUSE,使用 --no-sandbox 参数

./Microi.OpenClaw-*.AppImage --no-sandbox

```

**方式二:deb 包安装(Ubuntu / Debian)**

```bash

sudo dpkg -i microi-openclaw_*.deb

# 如有依赖缺失,执行:

sudo apt-get install -f

```

**方式三:无图形界面的服务器(纯命令行部署)**

如果你的 Linux 服务器没有桌面环境,可以直接运行后端服务:

```bash

# 1. 安装 Node.js 22(推荐使用 nvm)

curl -o- https://raw.githubusercontent.com/nvm-sh/nvm/v0.40.3/install.sh | bash

source ~/.bashrc

nvm install 22

# 2. 安装 OpenClaw CLI

npm install -g openclaw@latest --registry https://registry.npmmirror.com

# 3. 克隆项目并安装依赖

git clone https://gitee.com/microi-net/microi.openclaw.git

cd microi.openclaw

npm install --registry https://registry.npmmirror.com

# 4. 构建前端

npm run build:web

# 5. 启动服务(前端 + 后端管理面板)

npm run start

# 服务默认监听 5567 端口,浏览器访问 http://你的服务器IP:5567 即可打开管理界面

```

> 💡 **后台运行提示**:可使用 `nohup`、`screen`、`tmux` 或 `pm2` 保持服务常驻:

> ```bash

> # 使用 pm2(推荐)

> npm install -g pm2

> pm2 start server/index.js --name openclaw -- --production

> pm2 save && pm2 startup

>

> # 或使用 nohup

> nohup npm run start > openclaw.log 2>&1 &

> ```

## ❓ 常见问题

> **Windows 开发者注意(使用 nvm4w 时)**

>

> 如果你使用 [nvm for Windows](https://github.com/coreybutler/nvm-windows) 管理 Node.js 版本,首次切换版本后 PowerShell 可能报错:

> ```

> 无法加载文件 npm.ps1,因为在此系统上禁止运行脚本

> ```

> 执行以下命令解决(只需一次):

> ```powershell

> Set-ExecutionPolicy -ExecutionPolicy RemoteSigned -Scope CurrentUser

> ```

### Q: 环境安装速度慢或失败?

程序默认走国内加速镜像(Node.js 镜像站 + npmmirror),正常情况下国内网络几十秒即可完成。如多次失败:

- 检查本机网络是否正常

- 在环境管理页面重试单项安装

- 也可手动安装 Node.js 22 并加入 PATH,程序会自动识别

### Q: 安装 OpenClaw CLI 失败?

```bash

# 手动安装(国内加速)

npm install -g openclaw@latest --registry https://registry.npmmirror.com

```

### Q: 端口 5567 被占用?

程序会自动尝试 5567 ~ 5576 共 10 个端口。如果全部被占用,请先释放端口。

### Q: 如何使用 Ollama 本地模型?

1. 安装并启动 [Ollama](https://ollama.com/)

2. 在配置编辑中选择 **Ollama** 模板

3. 确认 Base URL 为 `http://localhost:11434`

4. 填入模型名(如 `llama3.1`)

5. 保存并重启 Gateway

### Q: 如何从外网访问?

侧边栏底部显示当前服务的内网 IP 和端口。在路由器设置端口映射(将外网端口映射到该 IP:端口)即可外网访问。

### Q: Linux 服务器(无桌面)如何部署?

不需要 Electron 桌面环境,直接用 Node.js 运行后端即可。详见上方「**无图形界面的服务器(纯命令行部署)**」章节,通过浏览器访问管理界面。

### Q: Linux 运行 AppImage 报 FUSE 相关错误?

较新版本的 Linux 可能未预装 FUSE:

```bash

# Ubuntu/Debian

sudo apt-get install fuse libfuse2

# CentOS/RHEL

sudo yum install fuse fuse-libs

# 或直接加 --no-sandbox 参数运行

./Microi.OpenClaw-*.AppImage --no-sandbox

```

### Q: 安装插件超时或失败?

1. 切换下载源:在 **插件管理** 页面将下载源切换为 **CDN 加速源**

2. CDN 方式从 `https://static.itdos.com/openclaw` 下载,国内网络更稳定

3. 如果 CDN 也失败,检查网络连接或联系管理员确认 CDN 资源已上传

### Q: 启动 Gateway 报端口 18789 被占用?

程序启动时会**自动尝试终止**占用 18789 端口的旧进程。如果仍然报错:

```bash

# Windows:手动查找并终止占用端口的进程

netstat -ano | findstr :18789

taskkill /F /PID <上面查到的PID>

# macOS / Linux

lsof -i :18789

kill -9 📌 群号:51050055 · 点击徽章或扫描二维码即可加入 · 欢迎开发者与 AI 爱好者!

--- ## 📄 许可证 MIT License ---Made with ❤️ by Microi 吾码团队 · 让 AI 真正属于每一个人